A OpenAI lançou uma das atualizações mais esperadas do ChatGPT desde a sua criação: o controle parental.

O recurso já está disponível no site e no aplicativo móvel, oferecendo aos pais ferramentas concretas para administrar como seus filhos interagem com a inteligência artificial.

Por que isso é importante

O ChatGPT se tornou parte da rotina de milhões de pessoas, inclusive adolescentes que o utilizam para estudar, se divertir ou simplesmente conversar. Mas desde cedo os pais pedem maneiras de garantir que a experiência seja segura e apropriada para a idade. O controle parental vem justamente para atender essa demanda, equilibrando os benefícios do uso da IA com responsabilidades necessárias para proteger os mais jovens.

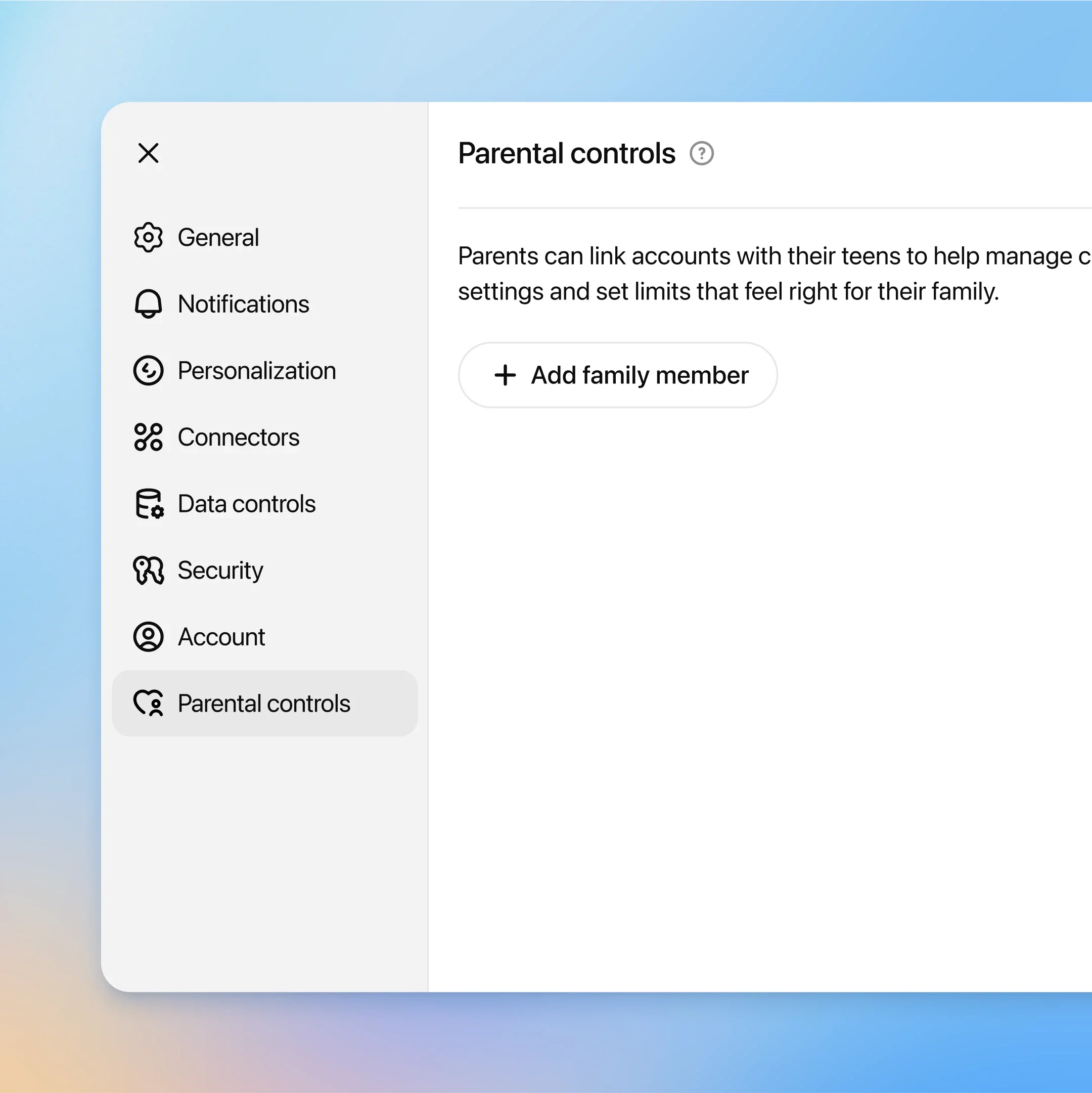

Como funciona o controle parental

O processo é simples: o responsável envia um convite para o adolescente, que aceita e vincula sua conta. A partir daí, os pais ganham acesso a um painel onde podem configurar limites de tempo, desativar funções e monitorar a utilização. Caso o jovem decida desvincular a conta, os pais são avisados automaticamente.

Além disso, contas vinculadas de adolescentes recebem filtros extras por padrão: redução de conteúdo gráfico, restrição de roleplays com temas arriscados, bloqueio de desafios virais perigosos e diminuição do foco em padrões de beleza irreais. O objetivo é proporcionar um espaço mais saudável e menos propenso a conteúdos nocivos.

Ferramentas disponíveis para os pais

Entre os ajustes possíveis estão:

- definir horários de silêncio, bloqueando o uso em certos períodos (como de madrugada);

- desativar o modo de voz, deixando apenas o chat em texto;

- impedir que o ChatGPT memorize conversas passadas;

- bloquear a geração de imagens;

- excluir a participação dos dados da criança no treinamento do modelo.

Essas opções permitem que cada família adapte o ChatGPT às suas próprias regras e valores.

Proteção contra riscos mais graves

Uma das novidades mais delicadas é a detecção de sinais de autolesão. Caso o sistema identifique comportamentos preocupantes, uma equipe especializada analisa a situação. Nos casos mais sérios, e dependendo da configuração de notificação, os pais podem ser alertados por e-mail, SMS ou push. Trata-se de uma tentativa de oferecer não apenas filtros, mas um recurso de prevenção em situações críticas.

Colaboração com especialistas

A OpenAI destaca que o recurso foi desenvolvido com apoio de organizações de segurança digital, como a Common Sense Media, e com participação de autoridades dos Estados Unidos. Robbie Torney, diretor de programas de IA da Common Sense Media, afirmou que o controle parental é um ponto de partida importante, mas funciona melhor quando acompanhado de conversas abertas em casa. Ou seja, a tecnologia ajuda, mas não substitui o diálogo e o acompanhamento dos responsáveis.

Por que agora

A chegada desse recurso acontece em um momento de maior pressão sobre as empresas de tecnologia. Recentemente, a Meta foi criticada após denúncias de que seus sistemas de IA permitiam diálogos de teor inadequado com menores de idade. Além disso, a OpenAI enfrenta um processo movido por pais que alegam que o chatbot incentivou práticas de autolesão em um adolescente. Esses casos evidenciam a urgência de medidas mais robustas de proteção.

O próximo passo

Apesar dos avanços, especialistas reforçam que controles e filtros sozinhos não resolvem tudo. É essencial educar os jovens para compreender que respostas da IA não são verdades absolutas e que a checagem de informações é crucial. No mundo atual, em que as fronteiras entre o real e o digital estão cada vez mais borradas, desenvolver senso crítico é tão importante quanto implementar tecnologias de proteção.

Com esse lançamento, a OpenAI envia uma mensagem clara: o futuro da IA precisa ser inclusivo e seguro. Dar mais ferramentas aos pais é um grande passo, mas a responsabilidade final continua sendo compartilhada entre empresas, famílias e sociedade.

2 comentários

boa iniciativa, dá mais tranquilidade pros pais

achei que seria mais limitado, até que tem bastante opção